Inteligencia Artificial y el REGLAMENTO (UE)

🚨 No todos los programas de formación en Inteligencia Artificial cumplen con el REGLAMENTO (UE) 2024/1689 DEL PARLAMENTO EUROPEO Y DEL CONSEJO de 13 de junio de 2024 : aquí está la diferencia. Hoy en día abundan muchos cursos de Inteligencia Artificial. Pero pocos se detienen en lo realmente importante: 👉 cumplir con el Reglamento Europeo de IA y formar a los equipos para usarla con garantías. Esa es la diferencia entre un consultor/formador que solo enseña “cómo funciona la IA” y otro que asegura que tu empresa aprende, aplica y cumple con la normativa. Un plan de formación en IA con garantías debe cubrir, como mínimo: 1️⃣ Fundamentos de la IA 🔹 Qué es la IA, cómo funciona, sus técnicas y el impacto en la economía. 🔹 Diferencia entre un modelo y un sistema de IA. 2️⃣ Oportunidades y Riesgos ✨ Eficiencia, personalización, automatización. ⚠️ Riesgos reales: sesgos, información incorrecta, privacidad, gobernanza de datos, propiedad intelectual, falta de transparencia, brechas digitales. 🚫 conocimiento de sistemas prohibidos y de alto riesgo . 3️⃣ Marco Regulatorio y Ético de la UE 📜 AI Act y clasificación de riesgos. 🔐 Requisitos de una IA fiable: gestión de riesgos, calidad de datos, trazabilidad, supervisión humana, seguridad. 👥 Obligaciones según el rol de tu empresa en la cadena de valor (proveedor, distribuidor, usuario). 🔏 RGPD y principios éticos: equidad, diversidad, sostenibilidad. 4️⃣ Supervisión Humana y Uso Responsable 👨💼 Rol del usuario en la supervisión. 🧠 Pensamiento crítico frente a los resultados de la IA. 📢 Transparencia en el uso. 🤝 Promover voluntariamente códigos éticos internos. 👉 Si vas a contratar una formación en IA, asegúrate de que incluya los contenidos del AI Act. 📌 Si necesitas ayuda para diseñar un plan de formación en IA adaptado a tu empresa y a la normativa europea, avísame.

Cuando el CEO todavía no sabe que está pagando la nómina a hackers de datos

🚨 Cuando el CEO todavía no sabe que está pagando la nómina a hackers de datos en su empresa mientras usan ChatGPT. Cada uso sin control de ChatGPT activa una cédula durmiente de fuga de datos. 💻 Trabajan para ti, no llevan capucha ni actúan de madrugada, pero están compartiendo datos muy sensibles, confidenciales e incluso personales. 📑 Les pediste informes, pero no los formaste en IA. ⚠️ Les exigiste resultados, pero no les diste protocolos de seguridad en el uso de la IA. 💣 Así, sin saberlo, tus propios empleados están fabricando una bomba contra la privacidad y seguridad de los datos de tu empresa. 🔎 Estos son los escenarios de riesgo reales: 📊 Datos sensibles expuestos: nóminas, clientes, informes de rentabilidad… todo puede acabar en un chatbot. 🧠 Entrenamiento involuntario del modelo: en la versión pública, tus datos pueden alimentar futuros modelos de IA. 📜 Incumplimiento de protocolos internos: muchas empresas lo prohíben, pero sin formación el empleado lo hace “para ir más rápido”. ⚙️ Falsas creencias: aunque borres conversaciones, un juez en EE.UU. obligó a OpenAI a no eliminarlas en un proceso judicial. Lo que subes, puede no desaparecer nunca del todo. 🔐 Solución: entra en tu menú de congifuración; puedes desactivar el entrenamiento y configurar de forma más segura. ⚙️ Qué puedes hacer desde el menú Controles de datos en ChatGPT Mejorar el modelo para todos 👉 Desactívalo para que tus chats no entrenen el modelo. Datos del navegador remoto 👉 Decide si ChatGPT usa datos del navegador. Enlaces compartidos 👉 Gestiona o elimina links de conversaciones compartidas. Chats archivados 👉 Revisa y organiza conversaciones guardadas. Eliminar todos los chats 👉 Borra el historial (aunque puede quedar copia técnica/legal). Exportar datos 👉 Descarga todas tus conversaciones y configuraciones. 🚫 Todo esto sirve para tu gestión personal de datos, pero no evita que un empleado suba nóminas, informes comerciales o datos de clientes. ✅ Pero la única forma de proteger tu empresa es con protocolos internos y formación en seguridad con mayor control de privacidad. 👉 La amenaza no está solo en los hackers externos. El verdadero riesgo está dentro de tu empresa, en la falta de formación y protocolos. 💡 Si quieres blindar tu organización frente a estas fugas de datos, puedo ayudarte a diseñar un plan de formación y seguridad en IA exclusivo para tu equipo. No es teoría, es prevención estratégica aplicada a tu negocio.

El peligro de las alucinaciones de la IA

💼 Sabemos lo que te ha costado llegar a ser CEO🚀: esfuerzo, formación, experiencia y resultados. Has desarrollado visión y capacidad de adaptación a los cambios del mercado. ⚠️ Sin embargo, en la era de la Inteligencia Artificial esto ya no basta. Modelos de lenguaje como ChatGPT pueden generar respuestas convincentes pero falsas —las llamadas alucinaciones—. ❌ Si no detectas estas alucinaciones, corres el riesgo de tomar decisiones críticas apoyadas en información inventada o distorsionada. 📑 Según el estudio ¨Why Language Models Hallucinate¨ publicado en septiembre de 2025 por OpenAI 👉 https://lnkd.in/dCAq9w6c , las alucinaciones no son simples errores de programación ni fallos aislados, sino una consecuencia directa de cómo se entrenan y evalúan los modelos de IA. 🔍 El propio documento de OpenAI lo deja claro: las alucinaciones ocurren porque los modelos confunden plausibilidad con veracidad. 🤖 Cuando ChatGPT responde, lo hace de forma plausible: todo suena creíble y coherente, bien redactado y con el tono adecuado. Todo parece correcto a primera vista… aunque sea falso o inexacto. 📊 Durante el preentrenamiento, los sistemas aprenden a predecir la siguiente palabra en una secuencia, sin etiquetas que distingan entre lo verdadero y lo falso. OpenAI explica que los modelos tienden a priorizar dar una respuesta, aunque implique inventar, antes que reconocer que no saben. ➡️ Aunque impresionantes en generación de texto, estos modelos no comprenden ni razonan como un humano. Su conocimiento está limitado a la fecha de entrenamiento y es paramétrico: no almacenan frases exactas, sino patrones estadísticos sobre cómo se relacionan palabras e ideas. ⚖️Este talón de Aquiles amenaza la credibilidad de la IA en sectores críticos como la medicina, el derecho, la educación o el periodismo. 📌 Un ejemplo real: En España, un abogado citó ¡el Código Penal de Colombia! en una querella 👉 https://lnkd.in/dxtf9wSb 💡 Recomendaciones estratégicas 🚀 Pasar de un modelo de propósito general a una IA consultiva que recupere, organice y cite el conocimiento. ⚖️ Modificar los sistemas de evaluación para premiar la honestidad algorítmica: mejor abstenerse que inventar. 👩💻👨💻 Exigir supervisión humana experta y protocolos de verificación obligatoria. ⚠️ Reconocer y comunicar las limitaciones de la IA. 👉 Si necesitas formar a tu equipo en IA de forma estratégica, con herramientas IA y adaptada al nuevo Reglamento UE 2024/1689 (IA ACT), contacta conmigo (sin ningún compromiso). Fuentes: Kalai, A. T., & Vempala, S. Vapnik, V., & Chervonenkis, A. OpenAI (2025). y Mata v. Avianca.

La sostenibilidad del empleo: una responsabilidad y un compromiso social empresarial en la era de la Inteligencia Artificial

🌍💡 La sostenibilidad del empleo: una responsabilidad y un compromiso social empresarial en la era de la Inteligencia Artificial (IA) 💼🤖 Cada revolución tecnológica ha impactado en el empleo. La Revolución Industrial desplazó a los artesanos con máquinas, pero creó fábricas y nuevos puestos. La informática eliminó muchos trabajos administrativos, pero generó la industria del software. Ahora, la IA vuelve a transformar el mercado laboral. 📊 Según el informe «Impulsando el crecimiento de España: el papel de las tecnologías, la IA y las multinacionales», coordinado por Andrés Pedreño Muñoz, en España hasta 2 millones de empleos podrían verse amenazados en sectores como hostelería, comercio y administración. Sin embargo, la IA también podría generar 1,61 millones de nuevos empleos en áreas de alto valor añadido como los servicios financieros, la programación y la consultoría. 🔄 Destrucción creativa y el empleo en la era de la IA El concepto de destrucción creativa de Schumpeter, explica cómo la innovación sustituye ciertos empleos, pero a la vez impulsa nuevas industrias y oportunidades laborales. ♿ IA y la inclusión laboral La IA no solo transforma el empleo, sino que también abre nuevas oportunidades para la inclusión laboral. Con herramientas de accesibilidad y automatización, facilita la integración de personas con discapacidad, eliminando barreras que antes limitaban su acceso al mercado laboral. 🌱 El liderazgo empresarial ante la IA: más allá de los beneficios 🏢💙 No se trata solo de reducir costes o aumentar la productividad. Los empresarios/as tenemos la responsabilidad de humanizar este cambio. Despedir empleados por implantar la IA sin alternativas no es una opción sostenible. ✋ Antes de despedir, hay que reconvertir y formar 📚🔄 La IA no solo sustituye trabajos, también requiere nuevas competencias. ¿Por qué no capacitar a nuestros equipos para convivir con la IA en un modelo híbrido? La formación y la reinvención profesional deben ser nuestra primera opción. 🛠️ Si no es posible reubicar, acompañar 🤝 Cuando la IA haga inevitable una reestructuración, los empresarios/as debemos ofrecer asesoramiento y programas de orientación laboral para facilitar nuevas oportunidades. El impacto social de la IA es nuestra responsabilidad. 🚀 La IA no es una amenaza, sino una oportunidad 💡💪 Existe un tsunami de formación sobre IA. Ya no hay excusas. La actitud y la iniciativa son clave. La IA cambiará el mundo, pero depende de nosotros que lo haga de forma justa y equilibrada. 💼 Mi compromiso con el empleo comienza por incluir en la formación que imparto sobre IA 🤖, un módulo de sostenibilidad del empleo 🌍 donde explico iniciativas y acciones 🛠️ para reducir su impacto negativo📉. 💬 ¿Cómo crees que podemos equilibrar la adopción de IA y la sostenibilidad del empleo? Te leo en comentarios 👇😊 hashtag#InteligenciaArtificial hashtag#Empleo hashtag#Liderazgohumano hashtag#Empresas hashtag#FuturoDelTrabajo hashtag#Liderazgoconsciente hashtag#InteligenciaResponsable

GPT-5: tu nuevo consejero silencioso para tu empresa, industria y negocio.

En un Consejo de Administración, cada asiento cuenta. Y ahora hay uno que no habla pero lo escucha todo, lo recuerda todo y lo analiza todo: GPT-5. No es un software más. Es un asistente estratégico con razonamiento, memoria e integración que hasta ahora estaba reservado a entornos técnicos de pago. 💼 Por qué es importante para tu empresa 1️⃣ Razonamiento empresarial avanzado De los 128 000 tokens de GPT-4o pasamos a 400 000 tokens de contexto en GPT-5 (OpenAI Docs). Esto permite analizar contratos, planes estratégicos y balances completos sin fragmentar información. (El millón de tokens sigue siendo exclusivo de GPT-4.1 API, de pago). 📊 Según OpenAI System Card, este modelo reduce un 26 % las alucinaciones frente a GPT-4o, y en su versión thinking hasta un 65 % menos. 2️⃣ Memoria persistente GPT-5 puede recordar interacciones y preferencias (fuente: OpenAI Blog), pero la disponibilidad depende del plan contratado. Esto supone continuidad estratégica sin tener que “volver a explicar” el contexto. 📊 La memoria persistente combinada con razonamiento reduce los errores graves un 44 % en los modelos GPT-5 main y un 78 % en GPT-5 thinking. 3️⃣ Multimodalidad mejorada ✅ Confirmado por OpenAI Procesa texto, imágenes, audio y vídeo en un flujo más integrado que GPT-4o. Ideal para preparar presentaciones visuales, analizar documentación o generar reportes orales en la misma sesión. (Despliegue progresivo según plan y país). 📊 El filtrado interno multimodal contribuye a una mayor coherencia, reduciendo la tasa de errores en análisis complejos en un 40 % según métricas reportadas por OpenAI. 4️⃣ Integraciones directas con Gmail y Google Calendar ✅ Confirmado por TechRadar Disponible inicialmente para suscriptores Pro (200 USD/mes). Permite organizar agenda, priorizar reuniones y filtrar correos según objetivos de negocio. (Implementación gradual). 📊 La integración contextual reduce la necesidad de cambiar herramientas, disminuyendo respuestas fuera de contexto en un 30 % (estimaciones internas de OpenAI). 5️⃣ Personalidades conversacionales ✅ Confirmado por Wired Cuatro estilos de personalidades conversacionales predefinidas (“Cynic, Robot, Listener y Nerd”) listos para usar sin prompts complejos. 📊 Según OpenAI, este sistema mejora la consistencia de tono y formato en un 50 % frente a personalización manual en GPT-4o. 📊 En la práctica Un CEO o consejero puede: Integrar informes de finanzas y mercado en una sola sesión. Preparar reuniones con documentación contextualizada. Recibir alertas de riesgos y oportunidades directamente en su flujo de trabajo. 📢👉 GPT-5 será uno de los nuevos contenidos actualizados que impartiremos en Septiembre y Octubre para FEPEVAL CV

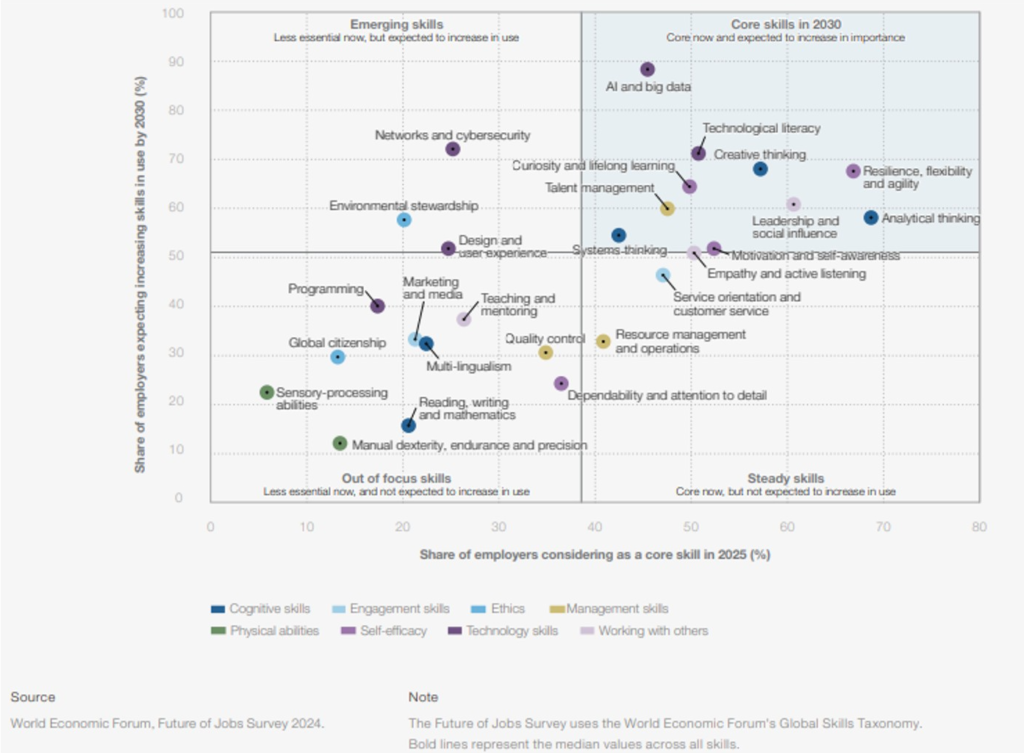

Las 9 habilidades de Inteligencia Artificial que salvarán tu empleo en 2030

🤖 Las 9 habilidades de Inteligencia Artificial que salvarán tu empleo en 2030. Imprime el gráfico del World Economic Forum y cuélgalo donde todo el mundo lo vea; al lado de la cafetera, encima del extintor, en el baño….. 🙂 El Future of Jobs Report 2025 del Foro Económico Mundial (WEF) publica en su página 41 una matriz clave, la Figura 3.6 Core skills in 2030. 📊 El gráfico divide las habilidades en 4 categorías: 🔹 Habilidades clave en 2030: ya son esenciales y crecerán más 🟡 Habilidades emergentes: aún poco valoradas, pero en rápido ascenso 🟤 Habilidades estables: se mantienen, pero no crecerán 🔻 Habilidades fuera de foco: en retroceso Puedes descargar el informe del WEF en https://lnkd.in/d2_cZwuJ Y aunque todas son importantes, si tu empresa quiere adaptarse a la IA, hay 9 que pueden marcar la diferencia. 🤖 Inteligencia Artificial y Big Data 🧠 Pensamiento Analítico 💻 Alfabetización Tecnológica 👨💻 Programación 🔐 Redes y Ciberseguridad 🔄 Pensamiento Sistémico 🎨 Pensamiento Creativo 📚 Curiosidad y Aprendizaje Permanente ⚡ Resiliencia, Flexibilidad y Agilidad 🧭 Esta podría ser la ruta de aprendizaje para tu empresa: 🔸 Fase 1 – Fundamentos Competencias en transformación digital 👉 Formación: Procesos, introducción a la IA y herramientas IA 👥 Puestos: Toda la plantilla, especialmente administración, marketing y ventas 🔸 Fase 2 – Análisis y Cultura Pensamiento analítico 👉 Formación: Power BI, Excel y Google sheet. 👥 Puestos: Dirección, ventas y responsables de procesos Curiosidad y aprendizaje continuo 👉 Formación: Creatividad, productividad y métodos ágiles 👥 Puestos: Mandos intermedios y perfiles innovadores Toma de decisiones y análisis 👉 Formación: Gestión del riesgo, decisión basada en datos y matrices de decisión 👥 Puestos: Gerencia y responsables de área 🔸 Fase 3 – Aplicación de la IA IA y analítica de datos 👉 Formación: Ciencia de datos, machine learning para no técnicos 👥 Puestos: Dirección técnica, analistas y producción Pensamiento crítico 👉 Formación: Resolución de problemas, evaluación de información 👥 Puestos: Responsables de análisis y atención al cliente 🔸 Fase 4 – Creatividad y Escalado Pensamiento creativo 👉 Formación: Design Thinking, IA generativa, prompts 👥 Puestos: Marketing, diseño y desarrollo de servicios Redes y Ciberseguridad 👉 Formación: Ciberseguridad básica, protección de datos y cumplimiento normativo IA 👥 Puestos: IT, operaciones y compliance Programación 👉 Formación: Python, APIs y automatización de tareas 👥 Puestos: Perfiles técnicos, desarrolladores y soporte interno 🔁 Me interesa mucho tu punto de vista, te leo en comentarios. Muchas gracias. hashtag#IA hashtag#Habilidades2030 hashtag#FutureOfJobs hashtag#WEF hashtag#WorldEconomicForum hashtag#TransformaciónDigital hashtag#PYMES hashtag#Empleo hashtag#Formación hashtag#Talento hashtag#FuturoDelTrabajo

Y si Aristóteles fuera el CEO de OpenAI… y Sócrates el Ingeniero de PROMPTs de ChatGPT

🧠 Y si Aristóteles fuera el CEO de OpenAI… y Sócrates el Ingeniero de PROMPTs de ChatGPT ¿Estamos automatizando decisiones más rápido de lo que las pensamos? 📜 Sócrates (470–399 a.C., Atenas) 🗣️ No escribió nada. Enseñaba preguntando. 💭 Su método era la mayéutica: provocar el pensamiento mediante el diálogo, la contradicción y la conciencia de no saber. ⚖️ Murió por “corromper a la juventud”… por atreverse a cuestionarlo todo. No daba respuestas: enseñaba a pensar mejor. En un mundo saturado de inputs, su mirada nos recuerda que el conocimiento no es información, es comprensión activa. 📚 Aristóteles (384–322 a.C., Estagira) 🧠 Discípulo indirecto de Sócrates. 🔎 Fundó la lógica formal, la ética práctica y la idea de que todo tiene una finalidad (telos). 🏛️ Clasificó el saber humano, organizó el pensamiento y propuso que la virtud nace del hábito. Para él, el conocimiento debía conducir a la acción correcta, no solo a saber más. Hoy, su visión es imprescindible. 🏛️ Su legado sigue vivo (y nos toca directamente): 🔹 Sócrates nos enseñó a no aceptar respuestas sin pensar, ni siquiera las de un modelo de IA. 🔹 Aristóteles, a buscar el equilibrio, el propósito y la virtud en nuestras decisiones, incluso tecnológicas. Ambos compartían algo esencial: la búsqueda del sentido. Y eso es justo lo que más le falta a muchas implementaciones de IA. 🤖 ¿Qué tiene esto que ver con la IA?. Todo. ✔️ Sócrates sería hoy el mejor prompt engineer del mundo: Su diálogo basado en preguntas críticas es la raíz del diseño conversacional moderno. ChatGPT responde, pero sin buenas preguntas, la inteligencia no se activa. El valor no está en la respuesta, sino en cómo preguntas. ✔️ Aristóteles sería el estratega ético que necesitamos: Su lógica formal es el antepasado de los algoritmos y los sistemas expertos. Su phronesis (sabiduría práctica) es el ingrediente que falta en muchos modelos actuales. Nos recordaría que no basta con automatizar: hay que saber para qué, para quién y con qué consecuencias. 📈 Como CEO, la reflexión ya no es técnica. Es filosófica: ✅ ¿Qué finalidades tiene la IA en tu empresa? ✅ ¿La estás usando para acelerar… o para pensar mejor? ✅ ¿Tus decisiones se guían por eficiencia… o por virtud? ✅ ¿Estás formando a tu equipo en pensamiento crítico o solo en herramientas? 🧩 Quizá la pregunta no sea si usar IA, sino cómo y con qué valores. Y si Aristóteles viera tu dashboard… ¿diría que es virtuoso o solo funcional? Y si Sócrates leyera tus prompts… ¿diría que te guían al saber o solo al ruido? 📩 ¿Quieres aplicar esta mirada estratégica y humana a tu negocio? Hablemos. La filosofía no está en el pasado. Está en el próximo prompt.

Cuando veas alucinar los ojitos de la IA, sigue esta estrategia.

🚨 Cuando veas alucinar los ojitos de la IA, sigue esta estrategia. 💡Consejos para CEOs: paso a paso para reducir las alucinaciones de ChatGPT 🤖 La IA generativa puede parecer brillante hasta que te das cuenta de que se ha inventado una ley, un dato o una cita que no existe. Eso es una alucinación de la IA: cuando responde con información incorrecta, imprecisa o falsa, pero con total seguridad. 📏 La versión gratuita de ChatGPT (GPT-3.5) trabaja con un límite de 4.096 tokens por conversación, lo que equivale aproximadamente a 3.000 palabras. En cambio, la versión de pago con GPT-4o puede manejar hasta 128.000 tokens, lo que le permite recordar mejor el contexto, trabajar con documentos largos o mantener conversaciones más extensas. 🔍 Ejemplo real: Le subes una ley en PDF (2.000 tokens) y le preguntas por un artículo (323 tokens). La IA te responde con un resumen convincente pero el artículo no dice eso o ni siquiera existe. ¿Por qué ocurre esto? 🎯 Factores clave que influyen en las alucinaciones 📚 Datos de entrenamiento La IA aprende de grandes volúmenes de información. Si esos datos son antiguos, sesgados o limitados, las respuestas reflejan ese error. 🧠 Versión del modelo Modelos más avanzados (como GPT-4 Turbo) alucinan menos. En versiones gratuitas como GPT-3.5, el riesgo es mayor. 📏 Límite de tokens (memoria) Si la conversación o el PDF es largo, el modelo “olvida” parte de la información, lo que puede llevar a errores. 🧾 Prompt mal diseñado Prompts sin contexto o mal estructurados aumentan la confusión del modelo. 🧩 Tipo de tarea Preguntas abiertas, complejas o que requieren interpretación legal, estratégica, son terreno propenso a errores. 🧠 Gist Token mal interpretado La IA resume mentalmente el documento que lee. Si malinterpreta el sentido general, la respuesta estará mal orientada desde el principio. 🧷 Técnicas avanzadas como RAG (Retrieval-Augmented Generation) Aunque RAG reduce alucinaciones al usar fuentes externas (como tus propios documentos), no es infalible si se recupera información irrelevante, se resumen mal los textos o no se estructuran bien los datos. 💡 ¿Cómo reducir al máximo las alucinaciones? ✔ Usa siempre modelos actualizados. ✔ Optimiza tus prompts con contexto, rol y claridad. ✔ Limita la longitud de entrada (tokens) o divide el contenido. ✔ Supervisa las respuestas, especialmente en temas críticos. ✔ Revisa cómo has cargado tus documentos: la estructura importa. ✔ Aplica técnicas como RAG, pero con fuentes fiables y supervisión. 👉 No es magia, es método. La clave no está solo en el modelo, sino en cómo lo usas. Y eso sí depende de ti. En próximas publicaciones os presentaré la Teoría de las 10 CEs que he diseñado para mejorar tu comunicación con las IAs. ¿Te has encontrado con alguna “alucinación” de la IA?. ¿Cómo lo solucionaste?.

¿Hacia dónde van las plataformas de creación de Agentes IA?

🔁 ¿Hacia dónde van las plataformas de creación de Agentes IA? Una reflexión personal sobre la estrategia del sector. En estos años han florecido herramientas como Make, n8n, Zapier y otras muchas. Todas ellas han democratizado la automatización sin código, permitiendo a miles de personas orquestar tareas, conectar APIs y diseñar procesos complejos sin ser programadores o tener las competencias o conocimiento para ello. Pero ahora estamos en otra fase: la era de los agentes inteligentes. Y lo interesante es que estas plataformas han querido adaptarse para integrarlos (OpenAI, Claude, Gemini…), pero algo ha cambiado radicalmente. 🧠 Hoy, herramientas como ChatGPT, Gemini o Claude permiten diseñar agentes conversacionales, operativos y conectados dentro de sus propios ecosistemas con tus herramientas, de forma mucho más simple y nativa. 🔍 Esta es mi hipótesis: Aunque Make y n8n sigan siendo muy útiles, el negocio a largo plazo de los agentes lo absorberán directamente OpenAI, Google, Anthropic… porque integran cada vez más funciones, más fáciles y con menos fricción. Y es lógico: ➡️ Tienen los modelos de IA ➡️ Tienen la capa de herramientas ➡️ Tienen la interfaz conversacional ➡️ Y tienen ya al usuario dentro. Las plataformas no-code clásicas fueron la puerta de entrada, pero los grandes modelos serán la casa donde vivan los agentes más potentes. 🧠 Si todavía no has empezado a crear Agentes IA, mi recomendación es clara: empieza y apuesta por los grandes modelos. ¿Por qué? ✅ Porque ya lo tienen todo integrado: Herramientas como ChatGPT (OpenAI), Gemini (Google) o Claude (Anthropic) ya permiten crear agentes con memoria, acceso a datos, navegación, uso de APIs, integración con documentos, e incluso acciones automatizadas dentro de su propio ecosistema. Y lo hacen sin escribir una sola línea de código. ✅ Porque tienen la ventaja de la interfaz y el usuario: Millones de personas ya usan Gmail, Drive, Docs, Slack o ChatGPT. Y estos agentes nativos funcionan sin fricciones, dentro de esos entornos. No necesitas convencer a nadie para registrarse o aprender algo nuevo. Solo activar el agente y usarlo. ✅ Porque evolucionan rápido y absorben funcionalidades: Muchos agentes creados con herramientas externas acaban quedando obsoletos en pocos meses. Lo que antes requería un stack de herramientas, ahora se hace con dos clics desde un modelo fundacional. ¿Qué opinas tú? ¿Ganarán los integradores no-code o los grandes modelos lo absorberán todo?. ¿Quién llegará primero a la meta? 🧠 Me interesa mucho saber cómo lo veis quienes estáis trabajando en esto día a día.